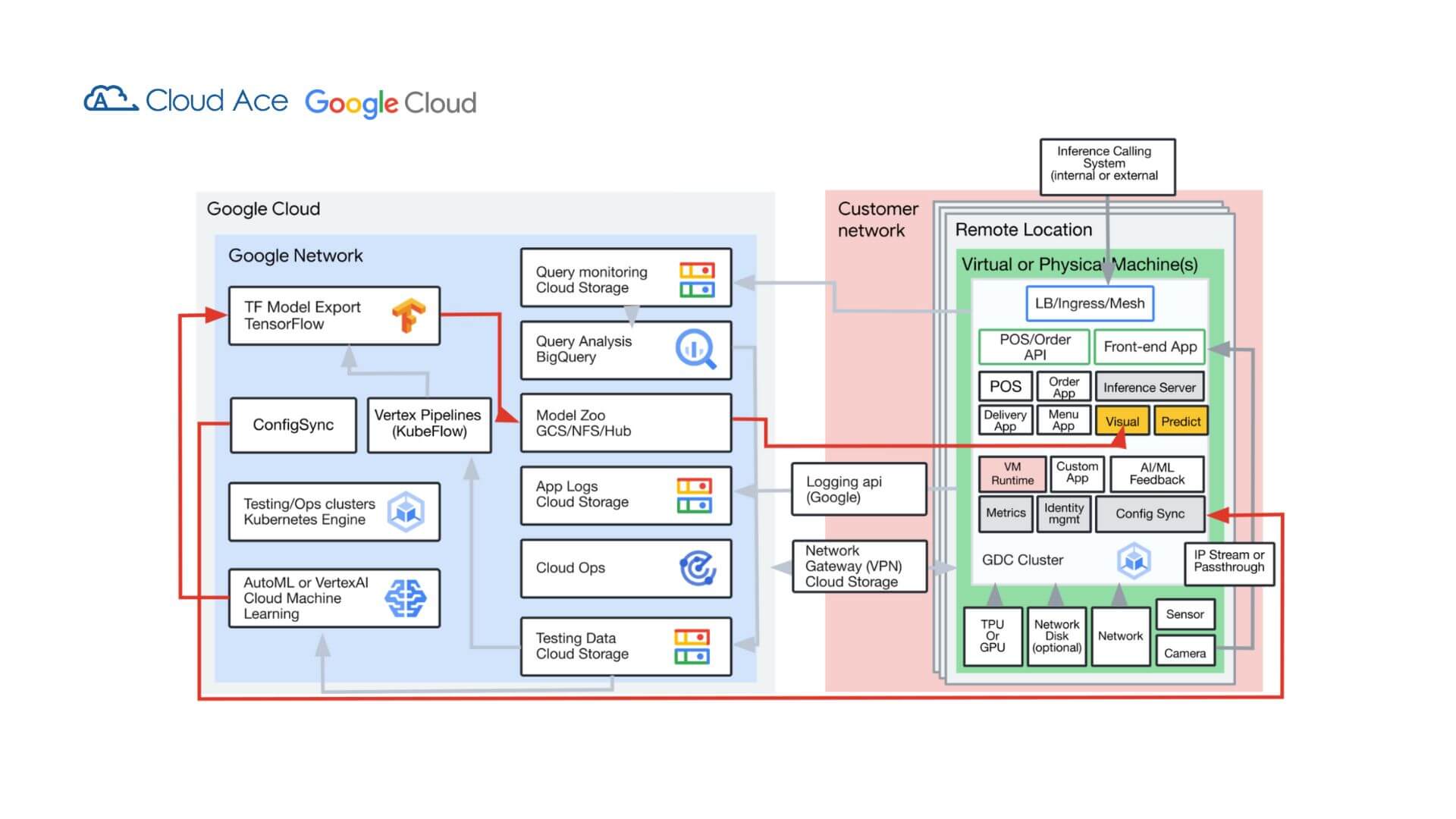

Suy luận AI tại biên – Giải pháp cho nhà bán lẻ

Đối với các doanh nghiệp nói chung và retailer nói riêng, viêc ra quyết định thông minh dựa trên dữ liệu real-time là điều đặc biệt quan trọng. Mặc dù việc áp dụng AI thường đòi hỏi nguồn đầu tư lớn, các doanh nghiệp có thể tận dụng tài sản hiện có như camera an ninh và hệ thống thanh toán để khai thác các tiềm năng AI. Bài viết dưới đây của Google Cloud sẽ chỉ ra làm thê nào suy luận AI ngay tại biên có thể giúp tối ưu hóa phân tích cửa hàng, giao dịch nhanh và nâng cao hiệu quả mà không tốn kém. Hãy cùng Cloud Ace tìm hiểu nhé.

Doanh nghiệp có thể xây dựng nền tảng AI như thế nào?

Các doanh nghiệp có thể khai thác tiềm năng AI ở mọi góc độ. Bằng cách chuyển đổi các kho tài liệu như sổ tay hướng dẫn, tài liệu đào tạo và quy trình vận hành thành các tài sản cho AI, họ có thể gia tăng năng suất làm việc của nhân viên.

Các tài liệu liên quan đến thiết bị cửa hàng, quản lý nhân sự, phòng ngừa thất thoát và thông tin chuyên ngành có thể được tích hợp cùng agent-based AI assistant để cung cấp các "trợ lý hành động tiếp theo" có nhận thức ngữ cảnh.

Với việc mở rộng ứng dụng AI từ cloud xuống adge, nhân viên bán lẻ có thể hỏi trợ lý AI, “Tôi nên làm gì tiếp theo?” và sẽ nhận được câu trả lời chi tiết, nhanh chóng, phù hợp với nhu cầu của họ.

Lựa chọn giữa CPU vs GPU

Việc lựa chọn phần cứng phù hợp giữa CPU và GPU để vận hành các ứng dụng AI là rất quan trọng. Quyết định này đòi hỏi cân nhắc hiệu suất, băng thông, xử lý mô hình và chi phí, đặc biệt khi triển khai tại trung tâm dữ liệu hoặc thiết bị biên.

Decision matrix (chart):

Tính năng | CPU | GPU | Trường hợp sử dụng |

Chi phí | Thấp | Cao | Phân tích cơ bản, đếm số người và phát hiện đối tượng đơn giản |

Hiệu suất | Bắt buộc; Phù hợp cho các nhiệm vụ chung | Không bắt buộc; Phù hợp với xử lý đa nhiệm | Complex AI, Phân tích video, xử lý hình ảnh độ phân giải cao, đào tạo các mô hình máy học |

Tiêu thụ | Thấp | Cao | Phù hợp cho vị trí xa, thiết bị dạng nhỏ |

Độ trễ | Vừa phải | Thấp (cho các tác vụ song song) | Các ứng dụng real-time, yêu cầu phản hồi tức thì |

Vị trí triển khai | Biên (Edge) hoặc Trung tâm dữ liệu khu vực (Regional DC) | Thường tại biên (Edge), nhưng có thể ở trung tâm dữ liệu khu vực (Regional DC) | Được xác định bởi độ trễ, băng thông và nhu cầu xử lý dữ liệu |

Tiêu chí ra quyết định

- 🔹 Độ phức tạp của mô hình AI: Mô hình đơn giản như phát hiện đối tượng có thể chạy tốt trên CPU, nhưng các mô hình phức tạp như: phân tích video real-time hay đề xuất cá nhân hóa thường cần GPU.

- 🔹 Khối lượng và tốc độ dữ liệu: GPU sẽ phù hợp khi doanh nghiệp cần xử lý dữ liệu lớn với tốc độ cao, trong khi CPU chỉ đủ cho bộ dữ liệu nhỏ và thông lượng thấp.

- 🔹 Yêu cầu độ trễ: GPU giúp giảm độ trễ cho các ứng dụng real-time, đặc biệt khi triển khai tại biên. Tuy nhiên, network latency có thể ảnh hưởng nếu GPU nằm tại trung tâm dữ liệu khu vực.

- 🔹 Ngân sách: GPU đắt hơn CPU. Doanh nghiệp cần cân nhắc ngân sách và ROI trước khi quyết định. Nên bắt đầu với CPU và nâng cấp lên GPU khi cần thiết.

- 🔹 Mức tiêu thụ năng lượng: GPU tiêu thụ nhiều năng lượng nhiều hơn CPU, đặc biệt khi triển khai tại biên. Tuy nhiên, tại trung tâm dữ liệu khu vực, vấn đề này ít đáng lo ngại.

- 🔹 Vị trí triển khai: Triển khai tại biên giúp giảm độ trễ cho ứng dụng real-time. Trung tâm dữ liệu khu vực sẽ phù hợp với các tác vụ không yêu cầu độ trễ thấp.

Không phải tất cả các ứng dụng AI/ML đều cần GPU. Ví dụ, kiểm tra trực quan cho phân tích lưu trữ và thanh toán nhanh có thể thực hiện trên CPU, với suy luận ở 5FPS trong khi video chạy ở 25FPS, giúp tối ưu hóa việc sử dụng CPU. Tuy nhiên, khi yêu cầu độ chính xác cao, như theo dõi vật thể di chuyển nhanh với độ chính xác millimet, GPU là cần thiết vì CPU không đủ nhanh để xử lý ở 5FPS.

Có một lựa chọn trung gian giữa GPU và CPU. Các CPU hiện nay được trang bị phép toán nhân ma trận tiên tiến hỗ trợ tensor, giúp cải thiện hiệu suất cho mô hình AI và ML.

Ví dụ, việc chạy mô hình biên dịch cho OpenVINO. Google cũng sử dụng bộ xử lý Intel Core trong các Máy chủ và Google Distributed Cloud (GDC) Server, giúp tối ưu hóa toán học ma trận và cải thiện hiệu suất mô hình ML trên CPU so với các dịch vụ ML truyền thống.

Cloud Ace - Managed Service Partner của Google Cloud

- Trụ sở: Tòa Nhà H3, Lầu 1, 384 Hoàng Diệu, Phường 6, Quận 4, TP. HCM.

- Văn phòng đại diện: Tầng 2, 25t2 Hoàng Đạo Thúy, Phường Trung Hoà, Quận Cầu Giấy, Thành phố Hà Nội.

- Email: sales.vn@cloud-ace.com

- Hotline: 028 6686 3323

- Website: https://cloud-ace.vn/