Google Cloud Next 26′: Tầm Nhìn Về Agentic Enterprise (Phần 1)

Chúng ta đang bước ra khỏi kỷ nguyên Chatbot để tiến vào Kỷ nguyên Agentic. Google Cloud Next ‘26 đã xóa bỏ hoàn toàn ranh giới giữa AI hỗ trợ và AI thực thi. AI không chỉ phản hồi; nó chủ động suy luận và thực hành (reasoning and taking action). Các nhà lãnh đạo hiện đứng trước hai lựa chọn: Đón đầu lực lượng lao động tự trị, hoặc lỡ nhịp trong kỷ nguyên ‘chat’ cũ kỹ. Thay vì hỏi ‘AI biết gì?’, hãy xác định: ‘AI hoàn thành được quy trình nào cho doanh nghiệp?’. Cùng Cloud Ace khám phá những tâm điểm công nghệ tại Google Cloud Next ’26 – hành trình định hình tương lai của Google Cloud.

Gemini Enterprise được lột xác hoàn toàn

Tại Google Cloud Next '26, Google chính thức tái định nghĩa Gemini Enterprise thành một hệ thống toàn diện (end-to-end), khai mở 'Kỷ nguyên Agentic' cho cộng đồng doanh nghiệp toàn cầu.

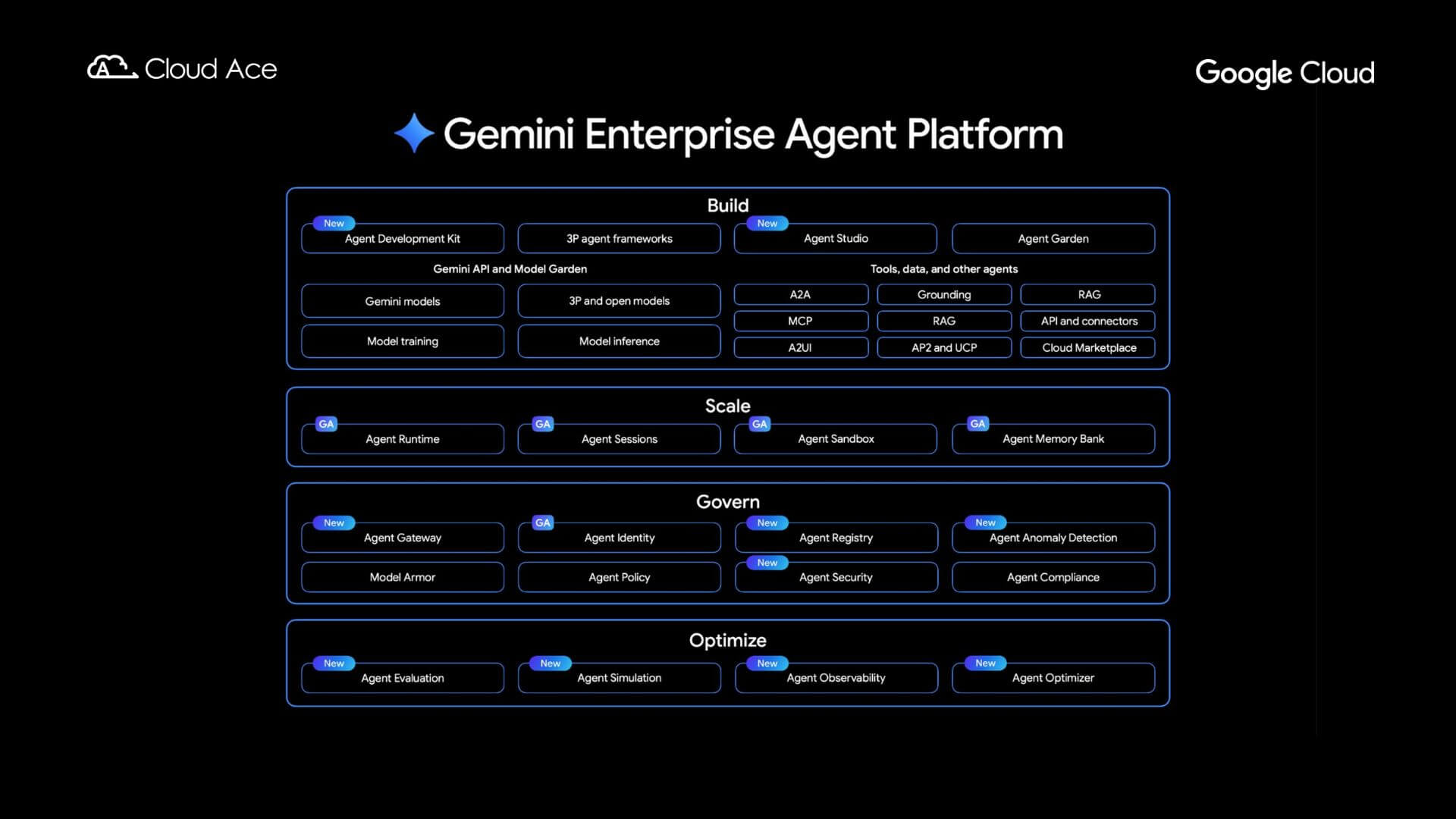

1. Gemini Enterprise Agent Platform

Tâm điểm của sự kiện lần này chính là Gemini Enterprise Agent Platform – nền tảng thế hệ mới thay thế hoàn toàn Vertex AI. Google mang đến một “điểm đến duy nhất” giúp doanh nghiệp phát triển, mở rộng, quản trị và tối ưu hóa các Agents một cách toàn diện. Hệ sinh thái này vận hành dựa trên 4 trụ cột sức mạnh:

▪️Build (Xây dựng): Nền tảng hợp nhất Agent Studio (giao diện kéo thả low-code) và Agent Development Kit (ADK) bản nâng cấp. Với kiến trúc graph-based, các kỹ sư giờ đây dễ dàng kiến tạo mạng lưới sub-agents phối hợp nhịp nhàng để giải quyết những bài toán hóc búa. Đặc biệt, khả năng multimodal streaming cho âm thanh và video trực tiếp giúp các tương tác trở nên mượt mà và chân thực hơn bao giờ hết.

▪️Scale (Mở rộng): Agent Runtime mới đẩy tốc độ khởi động hệ thống lên mức cực đại (dưới một giây). Đáng chú ý, bộ đôi Memory Bank and Memory Profiles giúp các agent sở hữu khả năng “ghi nhớ” dài hạn, duy trì ngữ cảnh cá nhân hóa xuyên suốt nhiều tháng. Doanh nghiệp cũng có thể vận hành các Long-running agents tự chủ hoàn toàn trong nhiều ngày nội tại các môi trường sandbox an toàn.

Govern (Quản trị): Google thiết lập tiêu chuẩn bảo mật tuyệt đối thông qua hệ thống kiểm soát trung tâm. Agent Identity cấp ID mã hóa riêng biệt để theo dõi quyền hạn chặt chẽ; Agent Registry quản lý kho thư viện nội bộ; trong khi Agent Gateway đóng vai trò “trạm kiểm soát không lưu”, kết hợp cùng Model Armor để chặn đứng mọi rủi ro từ prompt injection đến rò rỉ dữ liệu. Ngoài ra, Agent Anomaly Detection liên tục giám sát và phát hiện các hành vi bất thường theo thời gian thực.

Optimize (Tối ưu hóa): Để đảm bảo tính chính xác, bộ giả lập Agent Simulation cho phép doanh nghiệp đưa agent vào các kịch bản tương tác thực tế để kiểm thử. Song song đó, Agent Observability cung cấp cái nhìn xuyên thấu, giúp quản trị viên truy xuất toàn bộ lộ trình đưa ra quyết định của AI ngay tại thời điểm thực thi.

2. Các Mô Hình AI Tiên Tiến Nhất

Để vận hành thế hệ agent mới này, Agent Platform cung cấp cho doanh nghiệp đặc quyền truy cập vào các mô hình hàng đầu thông qua Model Garden:

▪️Gemini 3.1 Pro: Mô hình tiên tiến nhất được tối ưu hóa cho điều phối quy trình phức tạp.

▪️Gemini 3.1 Flash Image (còn gọi là Nano Banana 2): Đột phá trong việc tạo tài sản hình ảnh và giao diện độ phân giải cao.

▪️Lyria 3: Mô hình tạo âm thanh và âm nhạc chuẩn chuyên nghiệp.

▪️Hỗ trợ đa dạng: Cung cấp cả mô hình mở như Gemma 4 và các mô hình của đối tác như bộ ba Claude Opus 4.7, Sonnet, Haiku từ Anthropic.

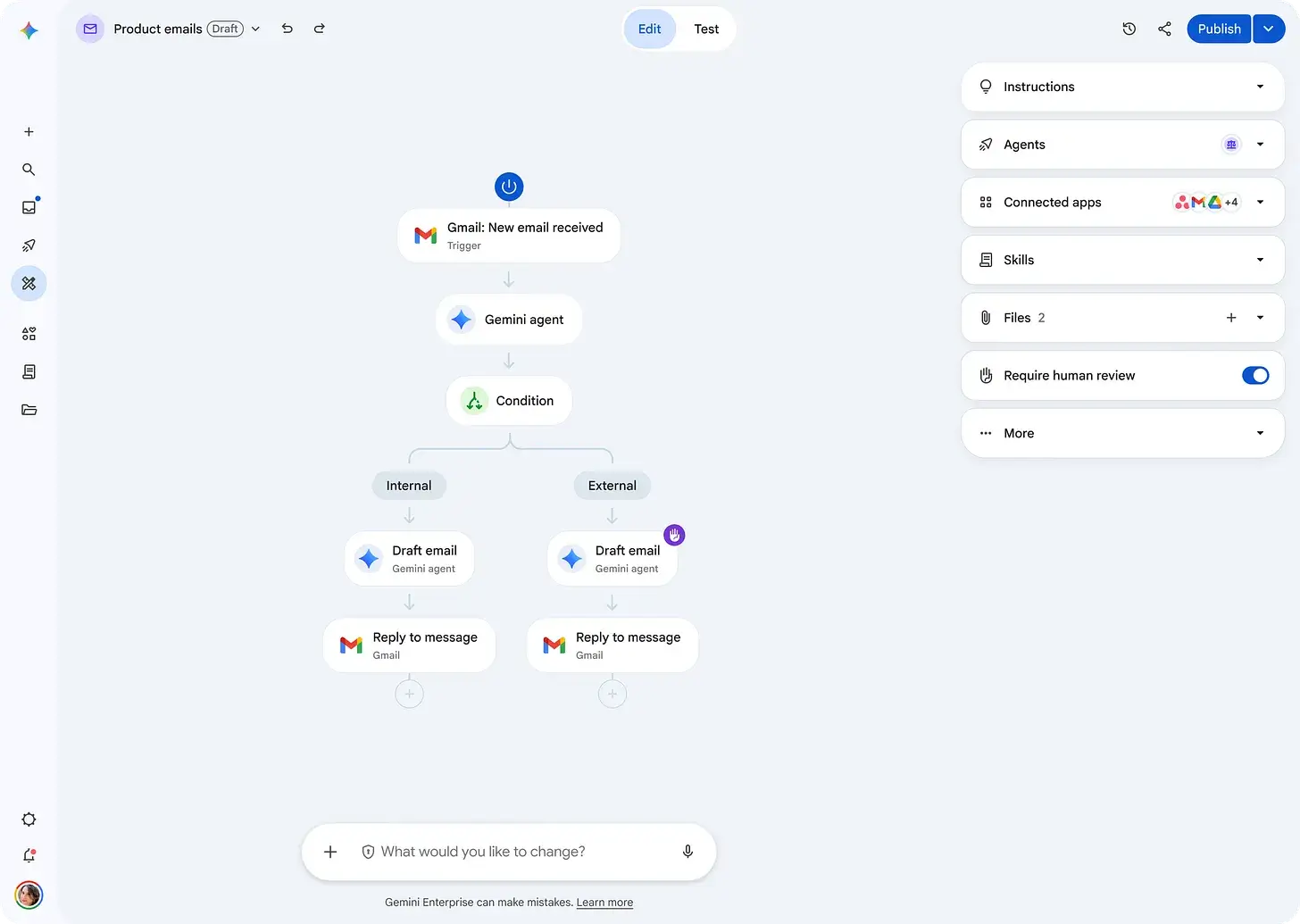

3. Gemini Enterprise App

Không chỉ giới hạn trong phòng kỹ thuật, Gemini Enterprise đưa sức mạnh AI đến từng bàn làm việc thông qua ứng dụng Gemini Enterprise app. Đây là “cánh cửa” bảo mật giúp nhân viên khai phá trí tuệ nhân tạo dựa trên nền tảng dữ liệu nội bộ của doanh nghiệp. Những nâng cấp đột phá bao gồm:

▪️Agent Designer & Skills: Xóa bỏ rào cản kỹ thuật, cho phép bất kỳ ai cũng có thể kiến tạo agent bằng ngôn ngữ tự nhiên thông qua giao diện trực quan. Với Skills, người dùng dễ dàng “đóng gói” các quy trình lặp lại thành phím tắt và kích hoạt tức thì chỉ bằng lệnh “@”.

▪️Inbox: Đóng vai trò là trung tâm điều khiển (command center) hiện đại. Tại đây, nhân viên trực tiếp quản lý, giám sát và thực hiện quyền can thiệp (human-in-the-loop) vào lộ trình thực thi của các agent, đặc biệt là các agent vận hành dài hạn.

▪️Projects & Canvas: Projects thiết lập không gian cộng tác chuyên sâu, nơi con người và AI cùng phối hợp làm việc với bộ nhớ ngữ cảnh riêng biệt cho từng dự án. Trong khi đó, Canvas đưa trình chỉnh sửa tương tác vào thẳng Google Docs và Slides, hỗ trợ khả năng tương tác chéo và xuất file sang định dạng Microsoft 365 một cách mượt mà.

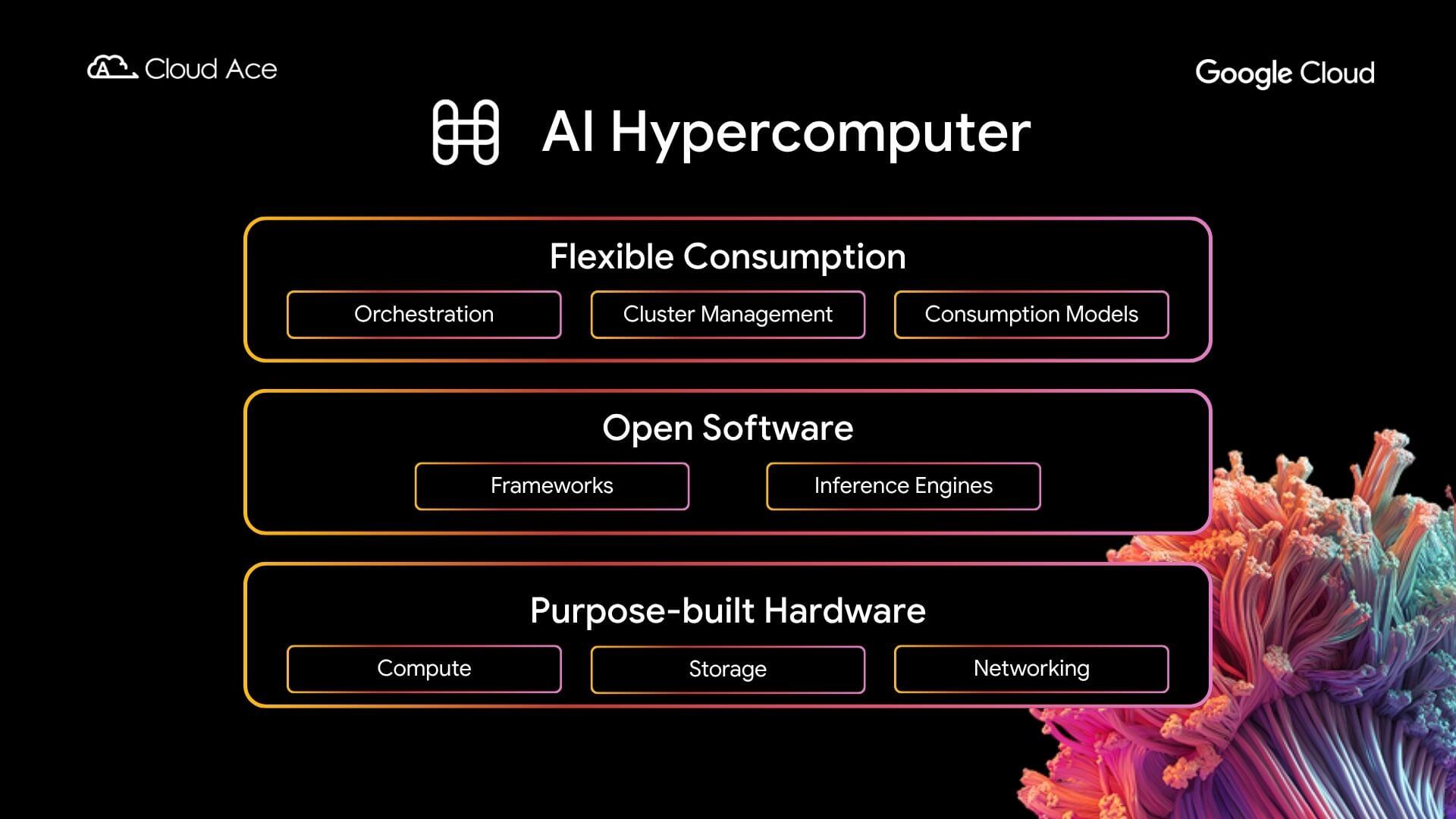

AI Hypercomputer

Nền Tảng Hạ Tầng Cốt Lõi Cho Kỷ Nguyên Agentic Enterprise

Cuộc dịch chuyển từ AI hội thoại (Chat) sang hệ thống Agentic AI buộc hạ tầng nền tảng phải thực hiện một bước nhảy vọt. Trong thực tế mới, một câu lệnh đơn giản có thể kích hoạt cả mạng lưới sub-agent cùng phối hợp, suy luận và hành động tức thời. Để tối ưu hóa chi phí và triệt tiêu độ trễ, Google Cloud trình làng bản cập nhật toàn diện cho AI Hypercomputer – hệ thống siêu máy tính hợp nhất từ silicon, phần mềm mở, mạng lưới đến lưu trữ, sẵn sàng gánh vác mọi tác vụ phức tạp của Kỷ nguyên Agentic.

Dưới đây là những đột phá mới nhất của AI Hypercomputer tại sự kiện Next ‘26:

1. Hạ tầng Silicon

Google mở rộng danh mục chip chuyên dụng, đảm bảo môi trường vận hành tối ưu cho mọi bài toán AI:

▪️TPU 8t (Tối ưu cho Huấn luyện): Vi xử lý thế hệ thứ 8 bứt phá hiệu năng gấp 3 lần so với tiền nhiệm. Cấu trúc của TPU 8t cho phép tích hợp 9.600 chip vào một superpod duy nhất, giải phóng sức mạnh tính toán 121 exaflops cùng 2 petabytes bộ nhớ dùng chung qua kết nối ICI (Inter-Chip Interconnect). Sức mạnh này rút ngắn thời gian huấn luyện mô hình từ hàng tháng xuống chỉ còn vài tuần.

▪️TPU 8i (Tối ưu cho Suy luận - Inference): Google thiết kế hệ thống này với độ trễ cực thấp nhằm phục vụ mạng lưới agent và các mô hình Mixture of Experts (MoE). TPU 8i nâng dung lượng SRAM trên chip gấp 3 lần (384 MB) và tăng HBM lên 288 GB, giúp lưu trữ trọn vẹn KV Caches ngay trên silicon. Với công cụ Collectives Acceleration Engine (CAE) chuyên dụng, TPU 8i giảm độ trễ tới 5 lần, đồng thời tối ưu hiệu suất trên giá thành thêm 80%.

▪️Hỗ trợ NVIDIA GPUs thế hệ mới: AI Hypercomputer hiện thực hóa sức mạnh của các máy chủ bare metal A5X, trở thành một trong những hệ thống tiên phong triển khai nền tảng GPU Vera Rubin NVL72 mới nhất từ NVIDIA.

▪️CPU linh hoạt với Axion và x86: Bên cạnh GPU/TPU, agent AI đòi hỏi sức mạnh CPU để xử lý các logic phức tạp, gọi công cụ (tool-calls) và vận hành vòng lặp phản hồi. Dòng máy ảo N4A chạy chip Axion (kiến trúc Arm tùy chỉnh của Google) mang lại hiệu suất trên giá thành tốt hơn 30% cho các ứng dụng agentic so với các giải pháp đối thủ.

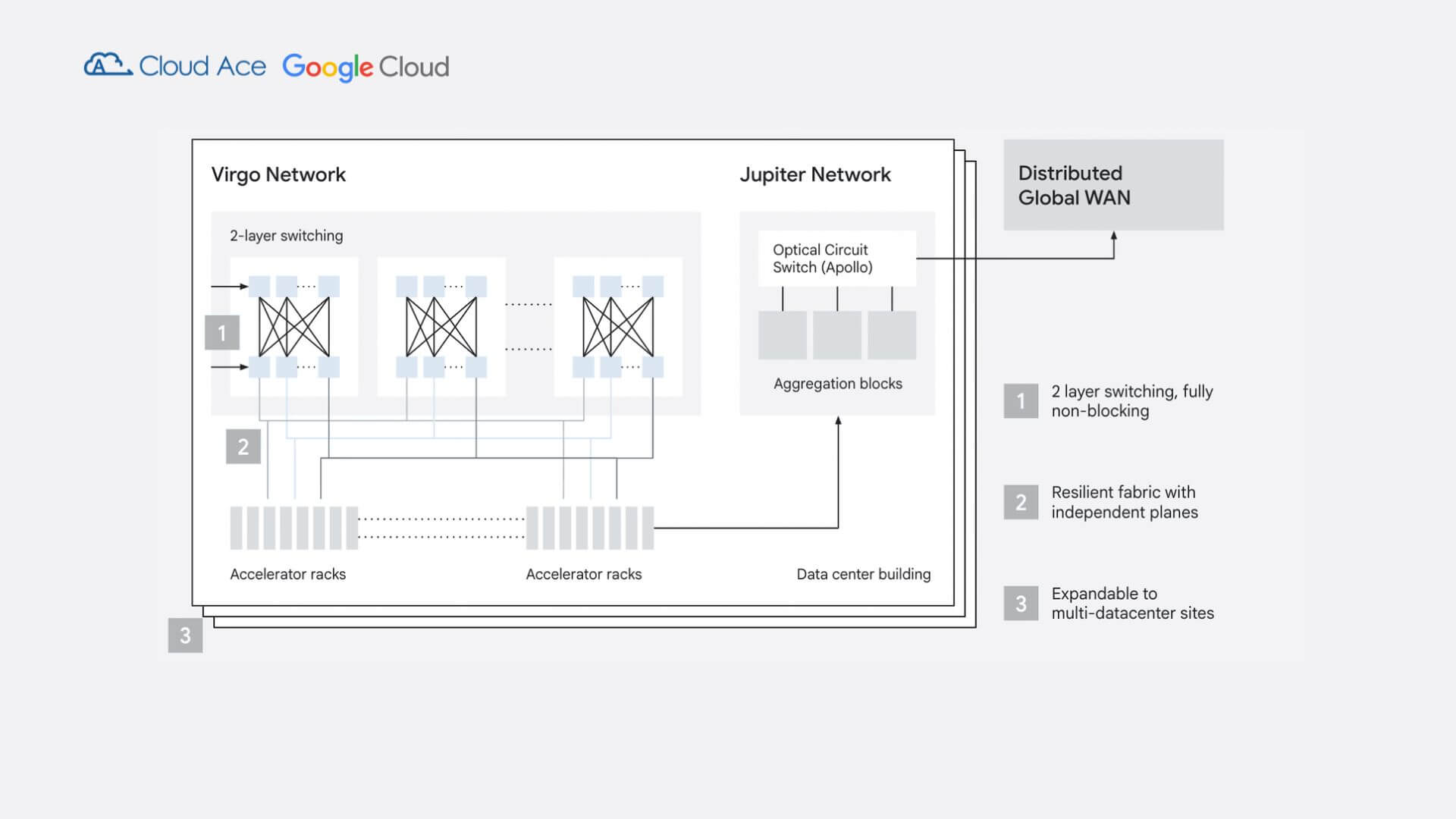

2. Hạ tầng mạng: Virgo Network

Khi hạ tầng mạng truyền thống chạm ngưỡng giới hạn trước bài toán kết nối các cụm siêu máy chủ, Google chính thức trình làng Virgo Network. Đây là kiến trúc mạng phẳng (flat), đa mặt phẳng (multi-planar) hoàn toàn mới, thiết kế chuyên biệt để khai phóng sức mạnh tối đa cho AI:

▪️Quy mô chưa từng có: Virgo Network sở hữu khả năng kết nối 134.000 chip TPU 8t thành một mạng lưới (fabric) duy nhất, cung cấp băng thông không chặn (non-blocking) lên tới 47 Petabits/giây. Nền tảng này đồng thời hỗ trợ kết nối quy mô lớn lên đến 960.000 GPU NVIDIA.

▪️Biến hạ tầng toàn cầu thành một siêu máy tính khổng lồ: Thông qua sự kết hợp giữa Virgo Network và hệ thống Jupiter, Google kết nối hơn 1 triệu chip TPU trải rộng trên nhiều trung tâm dữ liệu khác nhau vào một cụm huấn luyện duy nhất, xóa nhòa khoảng cách địa lý.

▪️Độ trễ cực thấp & Độ tin cậy tuyệt đối: Kiến trúc này tăng gấp 4 lần băng thông trên mỗi bộ tăng tốc và cắt giảm 40% độ trễ. Song song đó, cơ chế phát hiện tắc nghẽn và cô lập lỗi ngay tại cấp độ phần cứng giúp bảo vệ toàn vẹn tiến trình huấn luyện trước mọi rủi ro gián đoạn.

3. Lưu Trữ (Storage): Xóa Bỏ Nút Thắt Dữ Liệu

Sức mạnh tính toán khổng lồ sẽ trở nên vô nghĩa nếu hệ thống lưu trữ không cung cấp dữ liệu đủ nhanh. Google Cloud đã ra mắt các công nghệ lưu trữ đột phá:

▪️Cloud Storage Rapid: Biến lưu trữ đối tượng (object storage) truyền thống thành cơ sở hạ tầng hiệu năng cực cao. Tính năng Rapid Bucket tận dụng hệ thống Colossus để mang lại băng thông hơn 15 TB/giây và độ trễ dưới một phần nghìn giây, giúp lưu điểm chuẩn (checkpoint) nhanh hơn 3,2 lần và khôi phục nhanh hơn 5 lần. Rapid Cache cung cấp thông lượng đọc lên đến 2,5 TB/giây để hỗ trợ tải mô hình suy luận nhanh chóng.

▪️Google Cloud Managed Lustre cải tiến: Đạt băng thông lên tới 10 TB/giây (tăng 10 lần so với năm ngoái). Đáng chú ý là nó hỗ trợ tính năng TPUDirect và RDMA, cho phép dữ liệu đi thẳng vào các bộ tăng tốc (accelerators) mà không cần đi qua máy chủ lưu trữ (host), giúp tốc độ phản hồi của agent gần như ngay lập tức.

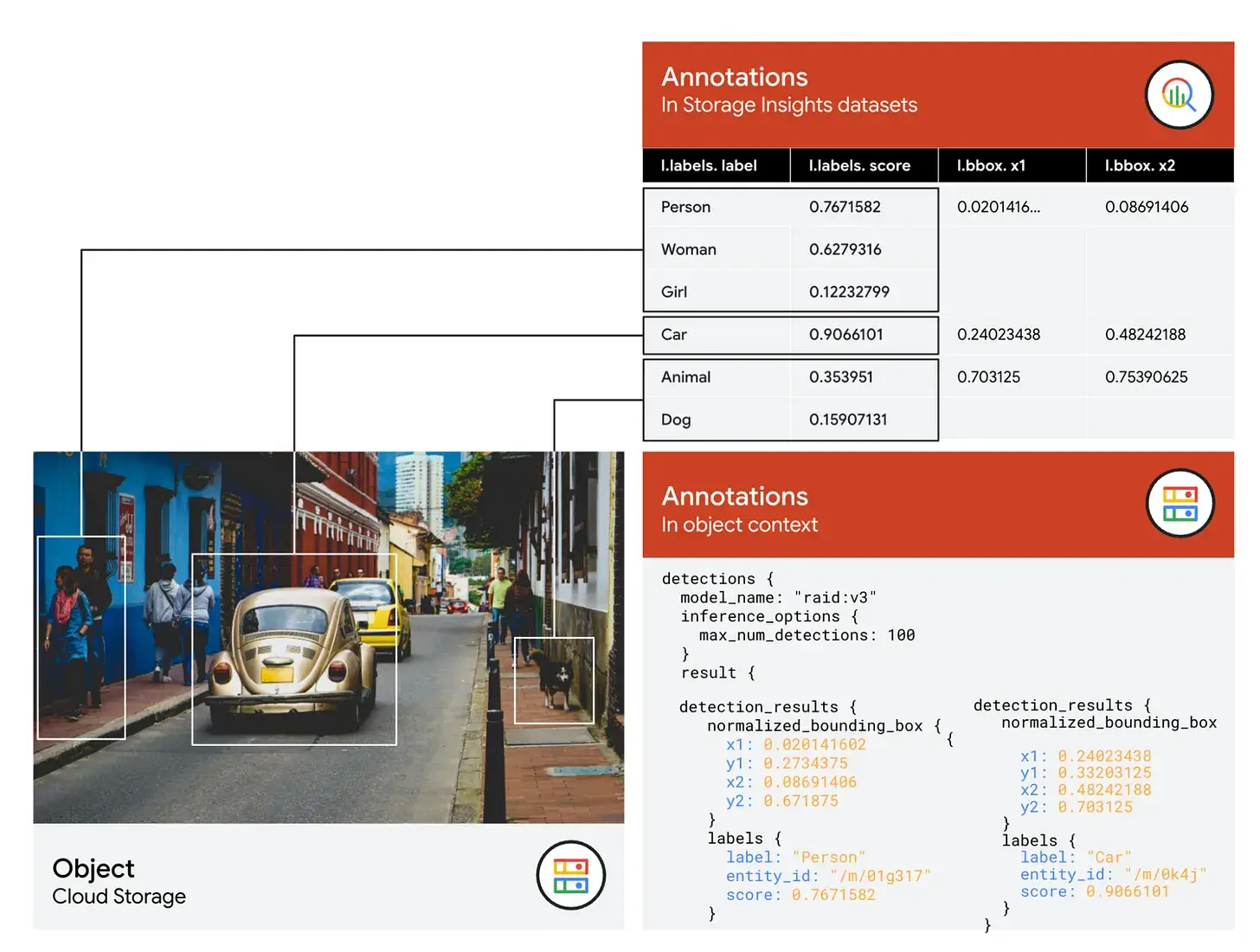

▪️Smart Storage (Lưu trữ Thông minh): Tự động gắn thẻ, trích xuất thực thể và tạo ngữ cảnh (metadata) cho các tệp phi cấu trúc ngay khi chúng được lưu trữ. Điều này cho phép các agent AI truy xuất ngữ cảnh và suy luận dựa trên dữ liệu doanh nghiệp mà không cần xây dựng hệ thống tìm kiếm riêng.

4. GKE & OSS: Hệ điều hành tối thượng cho các Agents

Google Cloud nâng tầm tốc độ triển khai và khả năng điều phối agent thông qua các bản cập nhật chiến lược trên Kubernetes Engine (GKE) và hệ sinh thái phần mềm mở:

▪️GKE Hypercluster: Bước đột phá này cho phép một control plane GKE duy nhất quản lý tới 1 triệu chip trên 256.000 nodes tại nhiều regions khác nhau. GKE Hypercluster chính thức biến hạ tầng phân tán thành một kho dự trữ năng lực tính toán hợp nhất và khổng lồ cho doanh nghiệp.

▪️GKE Agent Sandbox: Thiết lập môi trường thực thi biệt lập với tốc độ xử lý thần tốc cho các agent AI. Hệ thống sở hữu khả năng khởi chạy đồng thời 300 sandbox mỗi giây với độ trễ dưới một giây, cho phép các agent thực thi mã code không xác định một cách an toàn mà không gây tắc nghẽn quy trình.

▪️GKE Inference Gateway: Tích hợp trí tuệ nhân tạo để tự động điều phối lưu lượng, thay thế các phỏng đoán thủ công bằng tính năng Predictive Latency Boost. Gateway này tự động định tuyến dựa trên nhận thức năng lực (capacity-aware) theo thời gian thực, giúp cắt giảm tới 70% độ trễ cung cấp token đầu tiên (TTFT).

▪️Cam kết mã nguồn mở: AI Hypercomputer hiện hỗ trợ gốc cho PyTorch (thông qua TorchTPU), cho phép vận hành các mô hình trên TPU nguyên bản với đầy đủ tính năng như Eager Mode. Đồng thời, nền tảng tối ưu hóa hoàn toàn cho JAX and vLLM, mang lại sự linh hoạt tuyệt đối cho cộng đồng nhà phát triển.

Cloud Ace - Managed Service Partner của Google Cloud

- Trụ sở: Tòa Nhà H3, Lầu 1, 384 Hoàng Diệu, Phường Khánh Hội, TP. HCM.

- Văn phòng đại diện: Tầng 2, 25t2 Hoàng Đạo Thúy, Phường Yên Hòa, Thành phố Hà Nội.

- Email: sales.vn@cloud-ace.com

- Hotline: 028 6686 3323

- Website: https://cloud-ace.vn/