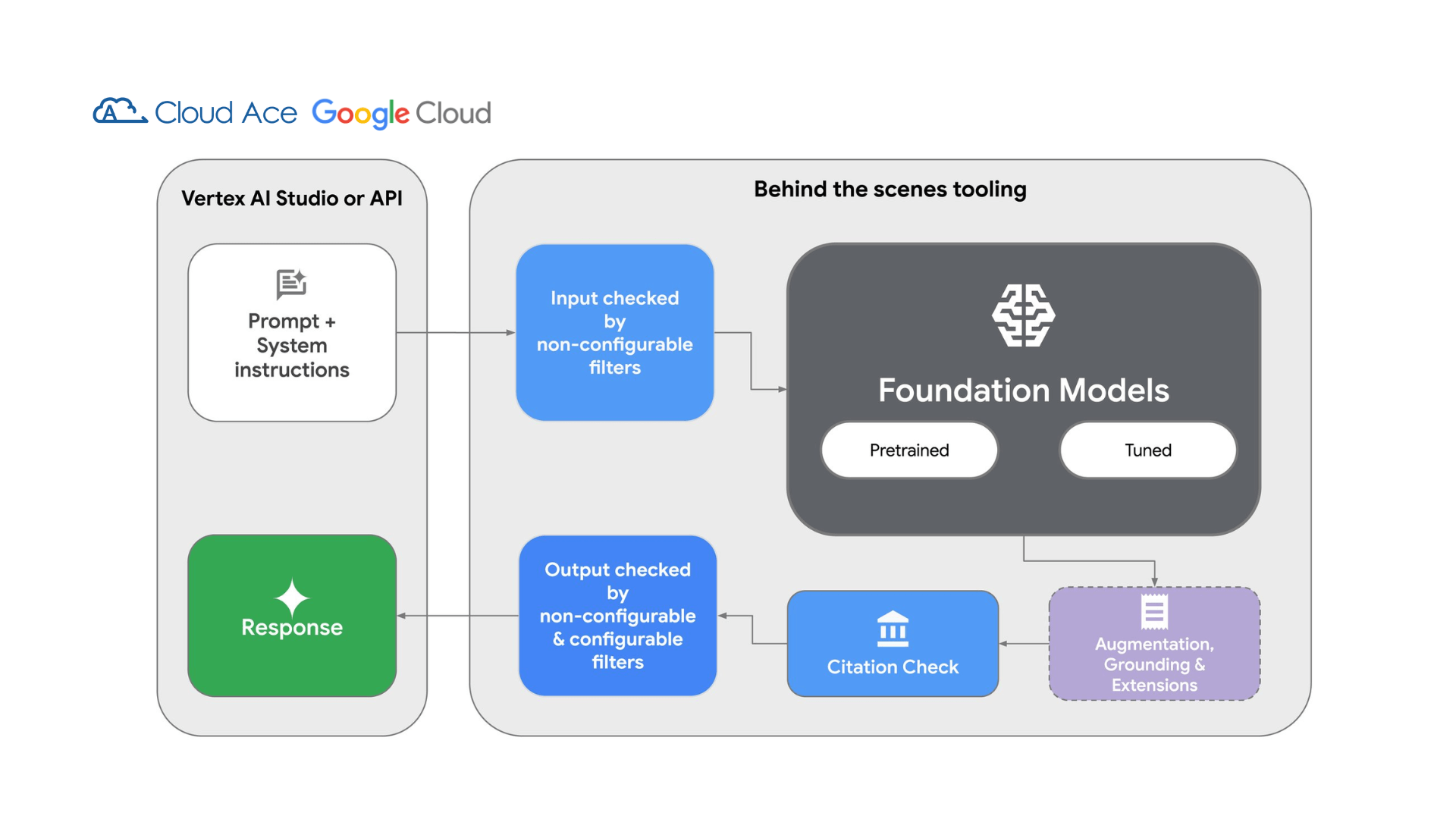

Content Filter (Bộ lọc nội dung) giúp ngăn chặn nội dung độc hại bằng cách phân tích văn bản được tạo ra và chặn các phản hồi vi phạm tiêu chí nhất định. Chúng hoạt động độc lập với các mô hình Gemini và là một phần trong hệ thống bảo vệ nhiều lớp nhằm ngăn chặn các hành vi cố tình vượt qua cơ chế kiểm soát của mô hình. Các mô hình Gemini trên Vertex AI áp dụng hai loại bộ lọc sau:

- 🔹 Bộ lọc an toàn mặc định: Tự động chặn các đầu ra chứa nội dung bị cấm, bao gồm tài liệu lạm dụng tình dục trẻ em (CSAM) và thông tin nhận dạng cá nhân (PII).

- 🔹 Bộ lọc nội dung tùy chỉnh: Cho phép điều chỉnh ngưỡng chặn cho bốn loại nội dung gây hại (phát ngôn thù ghét, quấy rối, nội dung khiêu dâm và nội dung nguy hiểm) dựa trên điểm xác suất và mức độ nghiêm trọng. Các bộ lọc này mặc định bị tắt, nhưng bạn có thể bật và điều chỉnh theo nhu cầu.